與我們合作

我們專注:網站策劃設計、網絡輿論監控、網站優化及網站營銷、品牌策略與設計

主營業務:網站建設、移動端微信小程序開發、APP開發、網絡運營、云產品·運維解決方案

有一個品牌項目想和我們談談嗎?

您可以填寫右邊的表格,讓我們了解您的項目需求,這是一個良好的開始,我們將會盡快與您取得聯系。當然也歡迎您給我們寫信或是打電話,讓我們聽到您的聲音

您也可通過下列途徑與我們取得聯系:

地 址: 上海市長寧區華寧國際7L

電 話: 400-825-2717(咨詢專線)

電 話: 13054973230(售后客戶服務)

網 址: http://www.586918.cn

傳 真: 021-61488448

郵 箱: admin@wumujituan.com

快速提交您的需求 ↓

北大騰訊提出多模態對齊框架LanguageBind

發布日期:2023-11-09 瀏覽次數:41772

要點:

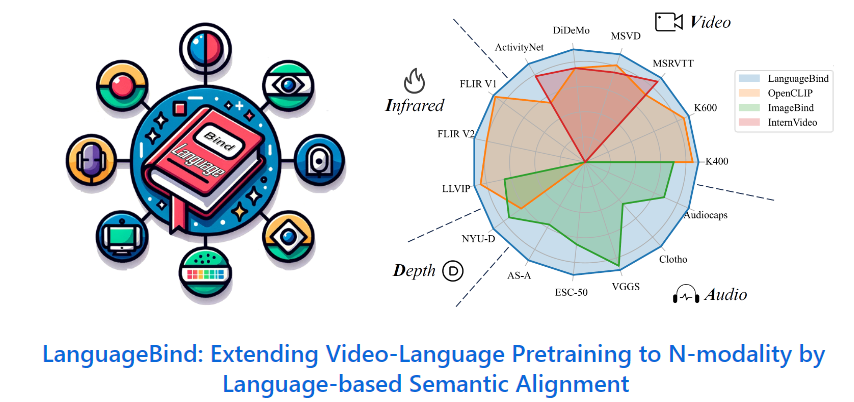

1、北京大學與騰訊等機構研究者提出了多模態對齊框架LanguageBind,并在多個榜單中取得了優異表現。

2、多模態信息對齊面臨挑戰,需要將不同模態信息進行整合與對齊,而新框架通過語言作為中心通道實現了多模態信息的語義對齊。

3、研究團隊構建了VIDAL-10M數據集,這是一個大規模、多模態數據對的數據集。

站長之家(ChinaZ.com)11月9日 消息:北大騰訊等提出了多模態對齊框架LanguageBind,這一新框架在多個榜單中獲得卓越表現。在現代社會,信息傳遞和交流不再局限于單一模態,而是多模態的。由于信息交互的復雜性,如何讓機器理解和處理多模態的數據成為人工智能領域的前沿問題。

當前主流的對齊技術通常會導致性能次優化,因此北大騰訊的研究團隊提出了一種新的多模態對齊框架——LanguageBind,該框架利用語言作為不同模態信息對齊的紐帶。在這個框架下,語言不再是附屬于其他模態的標注或說明,而是成為了聯合不同模態的中心通道。

項目地址:https://github.com/PKU-YuanGroup/LanguageBind

并通過將所有模態的信息映射到一個統一的語言導向的嵌入空間,實現了不同模態之間的語義對齊。該框架還構建了VIDAL-10M數據集,包含了視頻 - 語言、紅外 - 語言、深度 - 語言和音頻 - 語言配對,以確保跨模態的信息是完整且一致的。在多模態信息處理領域,LanguageBind的提出為多模態預訓練技術的發展奠定了堅實基礎。

該框架摒棄了依賴圖像作為主導模態的傳統方法,而是直接利用語言模態作為不同模態之間的紐帶。通過一系列優化的對比學習策略,LanguageBind實現了直接的跨模態語義對齊。這種方法避免了通過圖像中介可能引入的信息損失,提高了多模態信息處理的準確性和效率。

此外,該研究團隊構建了VIDAL-10M數據集,這是一個大規模、包含多模態數據對的數據集,涵蓋了視頻 - 語言、紅外 - 語言、深度 - 語言和音頻 - 語言等數據對。并經過了精心的質量篩選,確保了數據集的高品質和高完整性。這一舉措為跨模態預訓練領域提供了一個高質量的訓練基礎。對于多模態對齊框架LanguageBind的提出,有望為多模態學習領域帶來重要的進展和突破。